Unity3D与Kinect的结合为开发者提供了强大的交互体验,通过Kinect的体感识别技术,用户无需物理接触即可控制3D场景中的对象,以下是详细的Unity3D Kinect教程步骤,帮助开发者快速上手项目开发。

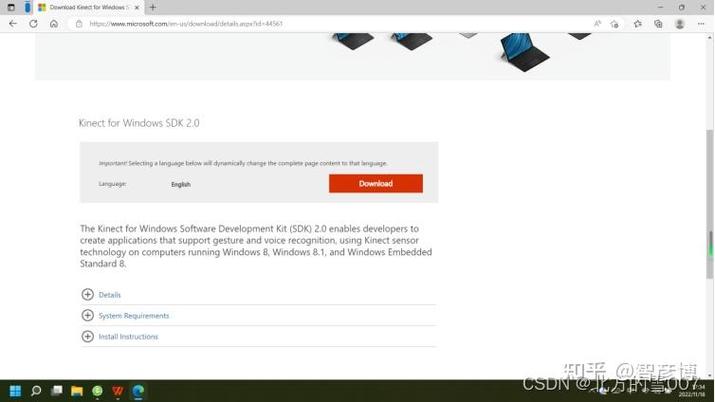

准备工作是关键,需要安装Unity3D(推荐2025.4或更高版本),Kinect for Windows SDK 2.0,以及Kinect与Unity3D的适配插件——Kinect2-Unity-Plugin,下载插件后,将其导入Unity3D的Assets目录,通过菜单栏的“Assets > Import Package > Custom Package”完成安装,硬件方面,确保Kinect 2.0传感器正确连接至电脑USB 3.0接口,并安装对应的驱动程序。

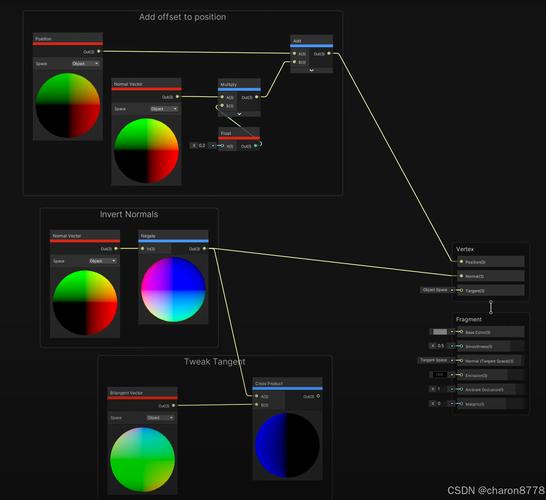

接下来是场景搭建,新建一个Unity3D项目,创建一个3D场景,添加一个平面作为地面,并放置一个立方体作为可交互对象,为了观察Kinect数据流,可以在场景中创建多个Quad(平面),分别用于显示深度图像、彩色图像和骨骼追踪可视化,将Quad的材质设置为Unlit/Texture类型,并通过脚本动态绑定Kinect的纹理数据。

脚本编写是实现功能的核心,创建C#脚本,命名为KinectController,首先引入必要的命名空间:using Kinect2Utils;,在脚本中声明Kinect2Manager组件的引用,该组件在导入插件后会自动出现在Unity3D的组件列表中,将Kinect2Manager拖拽到场景中的主摄像机或空对象上,并在脚本中通过public Kinect2Manager kinectManager;获取引用,在Start()方法中初始化Kinect数据流,例如kinectManager.StartDepthStream();和kinectManager.StartColorStream();。

骨骼追踪是Kinect的核心功能之一,通过kinectManager.GetBodyData()方法获取当前帧的骨骼数据,遍历每个关节点(如手部、头部)的位置信息,关节点的坐标是Kinect坐标系下的值,需要通过kinectManager.MapBodyPointToScreen()方法转换为Unity3D屏幕坐标,或直接使用kinectManager.MapBodyPointToWorld()获取3D世界坐标,获取左手关节点的3D位置:Vector3 leftHandPos = kinectManager.MapBodyPointToWorld(body.Joints[JointType.HandLeft].Position);,然后将该位置赋值给立方体的transform.position,实现手部控制立方体的效果。

为了优化性能,需要注意以下几点:1)在不需要时关闭Kinect数据流,如kinectManager.StopDepthStream();;2)使用对象池管理频繁创建的交互对象;3)在脚本中禁用不必要的组件更新,Kinect的识别范围和精度受环境光照影响较大,建议在室内稳定光线下使用。

以下是Kinect2数据流类型及用途的简要说明:

| 数据流类型 | 分辨率 | 用途 |

|---|---|---|

| 彩色图像 | 1920x1080 | 显示实时视频画面 |

| 深度图像 | 512x424 | 计算物体与传感器的距离 |

| 红外图像 | 512x424 | 低光环境下的辅助识别 |

| 骨骼数据 | 6人追踪 | 获取人体关节点位置 |

相关问答FAQs:

Q1:Kinect 2.0与Unity3D连接失败怎么办?

A1:首先检查Kinect传感器是否正确连接至USB 3.0接口,并确认Kinect for Windows SDK已安装,在Unity3D中,确保Kinect2-Unity-Plugin版本与SDK版本兼容,并在编辑器中查看Kinect2Manager组件是否有报错,若出现权限问题,尝试以管理员身份运行Unity3D编辑器。

Q2:如何提高骨骼追踪的准确性?

A2:优化追踪准确性的方法包括:1)确保用户站在Kinect的有效识别范围内(0.5米至4.5米);2)避免强光直射传感器或用户背后有强光源;3)用户穿着宽松衣物,避免肢体被遮挡;4)在KinectManager组件中调整“Body Tracking Confidence”参数,提高关节点识别阈值。